Искусственный интеллект (ИИ) революционизирует жизнь в 21 веке. Он меняет то, как мы работаем, получаем информацию и принимаем решения. Вряд ли какая-либо другая тема сейчас обсуждается так интенсивно в бизнесе, политике, науке и обществе. В то время как одни радуются технологическому прогрессу, другие видят значительные риски.

Для того чтобы Вы могли высказать свое мнение в дебатах об искусственном интеллекте и чтобы Ваша компания не потеряла связь с темой ИИ, стоит получить обоснованную информацию, которую предлагает следующая статья.

Ключевые выводы #

- Искусственный интеллект основан на алгоритмах, т.е. четких инструкциях по решению конкретных задач. Он обучается на больших объемах данных, чтобы распознать закономерности и вывести правила. Таким образом, он учится тому, что имеет наибольший смысл в тех или иных условиях.

- Генеративный ИИ может генерировать новый контент (например, создавать тексты, изображения или видео), следуя усвоенным правилам, вычисляя статистические вероятности на основе обучающих данных и постепенно подбирая элементы, которые лучше всего соответствуют подсказке.

- В отличие от людей, слабые системы ИИ не могут по-настоящему думать. У них нет ни сознания, ни эмоций, ни морали, ни интуиции.

- Будь то планирование маршрута, корректировка текста или персонализированный показ рекламы – искусственный интеллект уже однозначно присутствует в повседневной и профессиональной жизни. Он также играет важную роль в научных исследованиях (например, моделирование климата, раннее обнаружение рака).

- Обзор проблем, к которым может привести искусственный интеллект: Подтасовка фактов (галлюцинации), усиление дискриминации, мошеннические действия, глубокие подделки, увеличение потребления энергии, риски защиты данных и зависимость от технологических корпораций.

Что такое искусственный интеллект? #

На сегодняшний день не существует стандартизированного определения искусственного интеллекта. Однако с экономической точки зрения можно сказать, что искусственный интеллект – это способность компьютерных систем или машин выполнять определенные задачи, которые обычно требуют человеческого интеллекта. По своей сути, современные разработки в области ИИ – это воссоздание человеческих способностей с помощью статистических методов и алгоритмов. К ним, в частности, относятся:

- Обработка информации и хранение ее в виде знаний

- Анализ данных и распознавание закономерностей

- Понимание и генерирование человеческого языка

- Решение проблем, принятие решений и социальные действия

Чем искусственный интеллект отличается от естественного? #

Естественный интеллект создается нейронными процессами в человеческом мозге. Он неразрывно связан с сознанием, эмоциями, творчеством, моралью и ответственностью. Люди могут гибко переносить знания на новые ситуации, действовать интуитивно и улавливать взаимосвязи, даже когда доступно совсем немного информации.

Искусственный интеллект, с другой стороны, работает на основе данных. Ему нужны большие объемы данных, чтобы имитировать человеческий интеллект, он не осознает, что делает, и не думает, а вычисляет статистические вероятности. У него нет эмоций, морали или интуиции.

Какие существуют типы искусственного интеллекта? #

Искусственный интеллект обычно подразделяют на сильный и слабый ИИ.

Слабый ИИ #

Сегодня искусственный интеллект почти всегда относится к слабому ИИ. Он специализируется на выполнении четко определенных, повторяющихся задач особенно хорошо.

Однако слабый ИИ не может думать, вырабатывать намерения или размышлять о себе. Он не обладает творческими способностями и не учится самостоятельно, его нужно обучать. Его способность к обучению обычно ограничивается применением алгоритмов (четких инструкций по решению определенных задач) и распознаванием закономерностей в больших объемах данных. Это особенно полезно при автоматизации процессов на основе правил и при обработке языка и изображений.

Сильный ИИ #

Так называемого сильного ИИ, полностью эмулирующего человеческое мышление, еще не существует. Сильный ИИ мог бы не только выполнять отдельные задания по инструкции, но и теоретически обучаться и развиваться самостоятельно, находить творческие решения в совершенно новых контекстах, формулировать цели и реализовывать стратегии.

Сомнительно, что такая гипотетическая форма искусственного интеллекта сможет развить сознание. По всей вероятности, у него не будет настоящих эмоций, а только симулированные эмоции и нет интуиции, поскольку его решения по-прежнему будут основываться на вычислениях. Сильный ИИ мог бы следовать моральным правилам, но не чувствовать моральной ответственности, как человек.

Тест Тьюринга как критерий искусственного интеллекта #

Важной вехой в истории ИИ является тест Тьюринга, который был разработан в 1950 году британским математиком Аланом Тьюрингом. Изначально он предложил игру, чтобы выяснить, может ли машина или компьютер всесторонне обмануть человека, задающего вопрос, и, следовательно, обладает ли он способностью мыслить наравне с человеком.

Позднее сложность этого теста была снижена, так что сегодня тест Тьюринга известен в следующем виде: человек-испытуемый ведет разговор с двумя неизвестными партнерами по диалогу с помощью клавиатуры и экрана. Один из собеседников – человек, другой – машина. Если в результате интенсивных расспросов испытуемый не может достоверно определить, кто из них машина, значит, машина прошла тест Тьюринга. Таким образом, мы можем приписать машине слабый искусственный интеллект, как только она продемонстрирует коммуникативное поведение наравне с человеческим.

Что такое искусственный интеллект сегодня? #

Современные модели ИИ – особенно Большие Языковые Модели (Large Language Models, LLM) – очень близки к этому определению искусственного интеллекта в определенных сценариях. Новые версии ChatGPT уже прошли тест Тьюринга . Они могут имитировать человеческое общение в текстовом чате настолько искусно, что большинство людей уже не могут отличить их от реального человека и даже с гораздо большей вероятностью принимают их за людей, чем реальных собеседников.

Однако модель ИИ ChatGPT не является интеллектуальной в том смысле, что она намеренно обманывает и манипулирует людьми. Она лишь достоверно рассчитывает вероятность того, какие ответы собеседники, скорее всего, захотят услышать и какое социальное поведение считается уместным в определенной ситуации. Другими словами, прохождение теста Тьюринга означает не то, что машина действительно думает, а лишь то, что она убедительно имитирует человеческое поведение.

Типичные технологии в области ИИ #

Системы ИИ, такие как чат-боты и голосовые помощники, используют базовые процедуры для имитации человеческого поведения. Эти технологии ИИ включают

- Машинное обучение: Системы ИИ учатся решать конкретные задачи, используя статистические алгоритмы и большой объем обучающих данных.

- Глубокое обучение: Искусственные нейронные сети с большим количеством слоев позволяют обрабатывать особенно сложные входные данные, например, при распознавании речи и лиц.

- Обработка естественного языка: Компьютеры обрабатывают и анализируют естественный язык с помощью алгоритмов, например, для коррекции или генерации текста.

- Компьютерное зрение: Компьютеры обрабатывают и анализируют изображения с помощью алгоритмов, например, для распознавания паттернов и объектов и создания виртуальных миров.

Где используется искусственный интеллект? #

Почти наверняка Вы уже использовали искусственный интеллект в повседневной жизни – сознательно или бессознательно. Будь то планирование маршрута в навигационных системах, рекомендации по покупке в интернет-магазинах или автокоррекция и автодополнение текстов: Обученный искусственный интеллект используется повсюду, вычисляя наиболее вероятное решение для Вас на основе бесчисленных данных в фоновом режиме.

В медицинских исследованиях искусственный интеллект уже используется для улучшения диагностики и анализа изображений, например, при раннем выявлении рака. Исследователи также могут использовать искусственный интеллект для моделирования сценариев при определенных предположениях, например, для расчета глобального потепления с помощью климатических моделей или для эффективного использования ресурсов в сельском хозяйстве. Это ясно показывает, что технологии ИИ приносят огромную пользу обществу.

Области применения ИИ в экономике #

Искусственный интеллект также используется во многих компаниях. Поскольку производительность систем ИИ в последние годы стремительно растет, искусственный интеллект может анализировать огромные объемы данных за короткий промежуток времени и распознавать взаимосвязи, которые практически невозможно уловить человеку. ИИ помогает принимать более обоснованные решения, распознавая развитие событий на ранней стадии и моделируя сценарии. В частности, в офисной работе многие повторяющиеся задачи также могут быть автоматизированы с помощью ИИ. Вот несколько примеров из разных областей:

Промышленность и производство #

- Прогнозирование спроса и продаж для оптимизации цепочек поставок

- Предиктивное техническое обслуживание и ремонт машин

- Робототехника и автоматизированные производственные линии

Маркетинг и продажи #

- Персонализированный подход к клиентам при показе рекламы

- Более быстрое создание контента с помощью генеративного ИИ

- Анализ конкретных целевых групп для маркетингового плана

HR и развитие персонала #

- Стандартизированные собеседования с виртуальными помощниками

- Анализ квалификации и личностных характеристик кандидатов

- Прогнозирование потребностей в персонале в определенных сценариях

Общая администрация #

- Резюмирование или написание отчетов, электронных писем и т.д.

- Создание коммерческих предложений , подтверждений заказов и счетов-фактур

- Ответы на запросы в службу поддержки

Генеративный ИИ #

Генеративный ИИ – это, пожалуй, самая известная область применения искусственного интеллекта в настоящее время. Она стала популярной только в последние годы благодаря чатботам и ИИ-помощникам, таким как ChatGPT, Google Gemini, Microsoft Copilot, Amazon Alexa, DeepSeek, Midjourney и Perplexity. Однако сейчас мы уже почти привыкли к …

- искусственный интеллект может писать тексты

- искусственный интеллект может перефразировать и переводить тексты

- искусственный интеллект может создавать изображения

- искусственный интеллект может создавать видео

- искусственный интеллект может создавать музыку

Как работает искусственный интеллект в этих случаях? #

Генеративный искусственный интеллект объясняется просто: Обучаясь на больших объемах данных и выводя правила, он может создавать новый контент, который следует этим правилам. Он не создает ничего оригинального или творческого в истинном смысле этого слова, но вычисляет вероятности того, что имеет смысл делать дальше. Как и все существующие виды искусственного интеллекта, это слабый ИИ.

-

Текстовый генеративный ИИ работает с помощью токенизации: Языковая модель делит текст на лексемы (например, символы, слова и предложения), вычисляет вероятность для каждой возможной лексемы и затем решает, какая лексема статистически лучше всего соответствует введенному текстовому описанию (так называемой подсказке) следующей. При этом он применяет правила соответствующего языка.

-

Искусственный интеллект может создавать изображения с помощью диффузионных моделей: Модель начинает с полностью зашумленного, случайного изображения, из которого постепенно удаляется шум. Кодировщик сопоставляет текстовое описание с подходящими элементами изображения, которые содержались в обучающем материале модели. Пиксели меняются до тех пор, пока не будет создано четкое изображение, статистически достоверно соответствующее подсказке.

Как Вы видите, генеративный ИИ сильно ориентирован на формулировку вводимого текстового описания. Поэтому подсказка должна предоставлять модели ИИ точное описание с контекстом, спецификациями формата и стилями, чтобы достичь наилучшего результата. Подсказка – это ключевой навык при работе с современным ИИ.

Преимущества искусственного интеллекта с первого взгляда #

Некоторые из преимуществ систем искусственного интеллекта для компаний уже упоминались в этой статье. Здесь представлен обзор наиболее важных моментов:

- Автоматизация задач, основанных на правилах

- Более быстрый и всесторонний анализ больших объемов данных

- Улучшенная основа для принятия решений

- Избежание человеческих ошибок

- Последовательные результаты и круглосуточная доступность

Какие риски таит в себе искусственный интеллект? #

Мы все еще далеки от ужасного сценария, когда враждебный искусственный интеллект в будущем захватит мир и обратится против людей. Пока что существует лишь слабый ИИ, который нуждается в заранее определенных инструкциях и обучении со стороны людей и не может просто взять и начать жить самостоятельно. Тем не менее, искусственный интеллект таит в себе риск привести к нежелательным результатам или даже быть использованным в преступных целях.

Самыми большими проблемами, связанными с искусственным интеллектом, являются

Неправильные ответы из-за ошибочных данных

Галлюцинации и выдумывание фактов

Дискриминационные решения

Дезинформация и мошенничество с помощью глубоких подделок

Высокое энергопотребление центров обработки данных искусственного интеллекта

Защита данных и зависимость от технологических гигантов

Лучшие практики работы с ИИ в компаниях #

Согласно результатам исследования EY , более половины европейских компаний уже добились ощутимых преимуществ от использования ИИ – включая повышение производительности, экономию времени, сокращение затрат и уменьшение количества ошибок.

Для того чтобы использовать экономические возможности и разумно и безопасно применять искусственный интеллект в своей компании, следует придерживаться нескольких принципов:

- Человеческий контроль: Искусственный интеллект должен поддерживать решения, но не принимать их самостоятельно. Вы не должны просто верить результатам, а всегда тщательно их изучать и проверять.

- Прозрачность: Четко донесите до своих сотрудников рамочные условия использования ИИ. Это поможет Вам избежать создания теневого ИТ , о котором Вы ничего не знаете. Использование ИИ также должно быть понятно клиентам.

- Дополнительное обучение: Опыт работы с ИИ все больше становится фактором успеха. Подготовьте своих сотрудников и проясните с ними следующие вопросы: как работает искусственный интеллект и где используется искусственный интеллект?

- Суверенитет данных: Если Вы хотите использовать ИИ без ущерба для защиты данных , стоит запускать модели ИИ на собственных серверах или, по крайней мере, использовать облачные платформы на территории ЕС.

- Соответствие: Убедитесь, что системы искусственного интеллекта в Вашей компании соответствуют всем применимым законам и рекомендациям по соответствию, особенно Закону ЕС об искусственном интеллекте, потому что в случае сомнений Вы будете нести ответственность.

Что такое Закон ЕС об искусственном интеллекте? #

Закон Европейского Союза об искусственном интеллекте – это первый в мире закон о комплексном регулировании искусственного интеллекта. Он вступил в силу 1 августа 2024 года и будет полностью применяться со 2 августа 2026 года. Закон ЕС об ИИ подразделяет системы ИИ на четыре класса риска, к которым применяются различные правила:

- Недопустимый риск: Запрещены, например, социальный скоринг, биометрический мониторинг в режиме реального времени или контроль манипулятивного поведения, поскольку они несовместимы с защитой основных прав.

- Высокий риск: Использование искусственного интеллекта строго регламентировано в таких областях, как процедуры подачи заявок, кредитование и медицинская диагностика. Существуют высокие требования к качеству данных, прозрачности, человеческому контролю и документации.

- Ограниченный риск: Как только человек начинает взаимодействовать с ИИ (например, с чат-ботами), он должен быть проинформирован об этом, а контент, созданный ИИ, должен быть помечен как таковой.

- Минимальный риск: Приложения ИИ, такие как спам-фильтры, программы проверки орфографии или автоматические текстовые предложения в поисковых системах, не подлежат никаким дополнительным обязательствам.

Поставщики и операторы систем несут ответственность за любые нарушения закона и ущерб, причиненный приложениями ИИ, в размере до 15 миллионов евро или 3% от их глобального годового оборота.

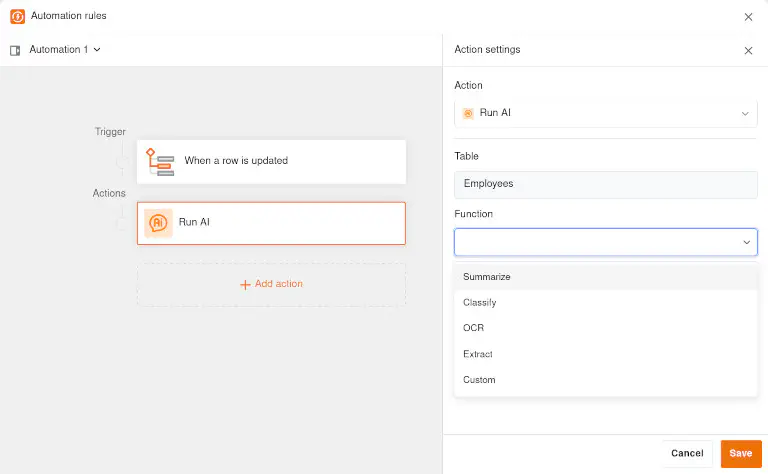

Используйте искусственный интеллект безопасно с SeaTable #

Будучи платформой без кода, SeaTable обеспечивает автоматизацию с поддержкой искусственного интеллекта, с помощью которой Вы сможете более эффективно организовать управление данными . Анализ, изменение и расширение записей данных, перевод текстов и извлечение нужной информации из документов – все это возможно с помощью функций искусственного интеллекта.

И никаких проблем с защитой данных: помимо Gemma 3, SeaTable в будущем будет поддерживать и другие модели ИИ от различных поставщиков, которые работают в немецких центрах обработки данных в соответствии с GDPR. Кроме того, обмен данными между SeaTable Cloud и языковыми моделями зашифрован.

Для полного контроля самостоятельные хостеры, конечно же, могут использовать модели AI в своей собственной инфраструктуре. SeaTable AI , компонент SeaTable Server , основан на LiteLLM и поэтому поддерживает подключение большого количества моделей с OpenAI-совместимым API.

Вывод: ИИ – это инструмент, а не замена человеческого интеллекта #

Искусственный интеллект – это, пожалуй, самая мощная технология нашего времени. Он может оптимизировать, автоматизировать и ускорять процессы, вычислять огромные объемы данных и получать новые знания – что делает его чрезвычайно ценным для компаний. Тем не менее, искусственному интеллекту еще далеко до того, чтобы стать мыслящим существом. Он может имитировать человеческие способности, но должен разрабатываться, обучаться и контролироваться людьми.

Ответственное использование искусственного интеллекта определит, станет ли он преимуществом или проблемой. Если в будущем Вы будете использовать искусственный интеллект в качестве инструмента для своей работы, Вам следует действовать мудро, прозрачно и в соответствии с правилами. Это позволит Вам получить выгоду от повышения эффективности и производительности в долгосрочной перспективе.

Часто задаваемые вопросы об искусственном интеллекте #

Насколько развит искусственный интеллект сегодня?

Как работает искусственный интеллект?

Что такое генеративный ИИ?

Где используется искусственный интеллект?

Какие проблемы может вызвать искусственный интеллект?

TAGS: Цифровая Трансформация Управление Данными И Визуализация Интеграции И Автоматизация